NOBELOVA NAGRADA ZA FIZIKU 2024

Što fizika ima s umjetnom inteligencijom? Nagrada koja je podijelila stručnjake

Davor Horvatić / 13. listopada 2024. / Perspektive / čita se 9 minuta

Davor Horvatić / 13. listopada 2024. / Perspektive / čita se 9 minuta

Davor Horvatić / 13. listopada 2024. / Perspektive / čita se 9 minuta

Davor Horvatić / 13. listopada 2024. / Perspektive / čita se 9 minuta

Ovogodišnja Nobelova nagrada iz fizike pokazuje spoj ljudske kreativnosti i briljantnu demonstraciju snage fizikalnih modela, piše Davor Horvatić. Iako je jedan dio fizičara revoltiran i smatra da je nagrada rezultat pretjerane fascinacije umjetnom inteligencijom, drugi tvrde da je riječ o opravdanom priznanju za revolucionarna postignuća.

Ovogodišnja Nobelova nagrada za fiziku pošteno je uzburkala fizičare i izazvala poprilično iznenađenje jer je dodijeljena pionirima umjetne inteligencije. Geoffrey Hinton i John Hopfield, nagrađeni su za svoj revolucionarni rad u polju strojnog učenja za ideje inspirirane fizikom. Jedan dio fizičara prilično je revoltiran i smatra da je ovo rezultat pretjerane fascinacije umjetnom inteligencijom, dok drugi tvrde da je riječ o opravdanom priznanju za revolucionarna postignuća. Čistunci se pitaju, gdje je naša Nobelova nagrada? Ovogodišnja Nobelova nagrada iz fizike pokazuje spoj ljudske kreativnosti i briljantnu demonstraciju snage fizikalnih modela, koji se uspješno primjenjuju u analognim sustavima kao što su neuronske mreže.

Kad govorimo o umjetnoj inteligenciji moramo naglasiti da ona tradicionalno ne spada u fiziku, nego u računarske znanosti. Kada u ovom tekstu vidite izraz umjetna inteligencija ili AI, on zapravo predstavlja, na žalost netočan, sinonim za strojno učenje. Daleko smo od prave umjetne inteligencije, multimodalni jezični modeli, poput ChatGPT, Claude.AI i ostalih, tek pokazuju natruhe AGI (skraćenica od eng. Artificial General Intelligence) i relativno je teško procijeniti kada će AI modeli doći do nivoa da mogu parirati ljudskoj inteligenciji. Strojno učenje je bolje zvati statističkim učenjem i ono je samo jedna od grana u onom što se (znanstveno) smatra pod pojmom umjetna inteligencija.

John Hopfield, američki fizičar i neuroznanstvenik, rođen je 1933. godine, diplomirao je fiziku na Harvardu, a doktorirao na Cornellu. 1982. godine predstavio je model neuronske mreže poznat kao Hopfieldova mreža. U svom radu “Neural networks and physical systems with emergent collective computational abilities” (Proc. Natl. Acad. Sci. USA, 1982), Hopfield je pokazao kako se koncepti iz statističke fizike mogu primijeniti na neuronske mreže.

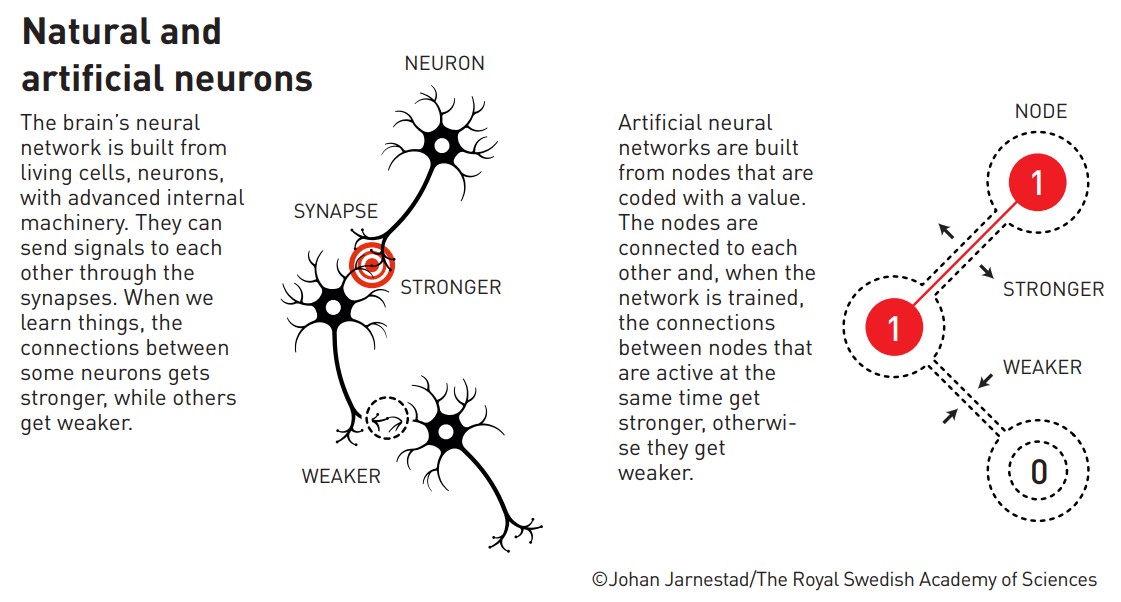

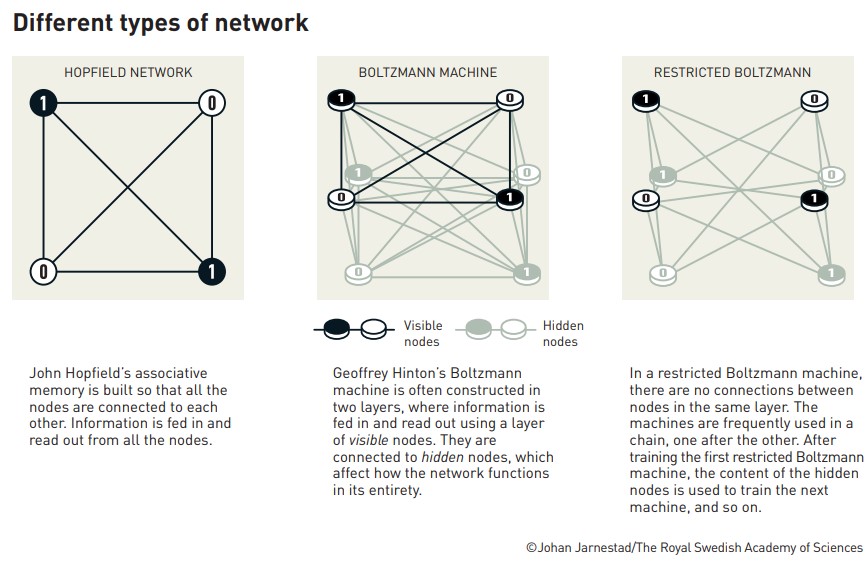

Hopfieldova mreža je vrsta rekurentne neuronske mreže (RNN) koja djeluje kao asocijativna memorija – informacije se pohranjuju tako da, čak i ako dobijete samo dio informacije, cijeli obrazac se može rekonstruirati. Slično radi i naš mozak, ne moramo imati savršenu sliku nama poznate osobe da bi prepoznali da se radi o njoj.

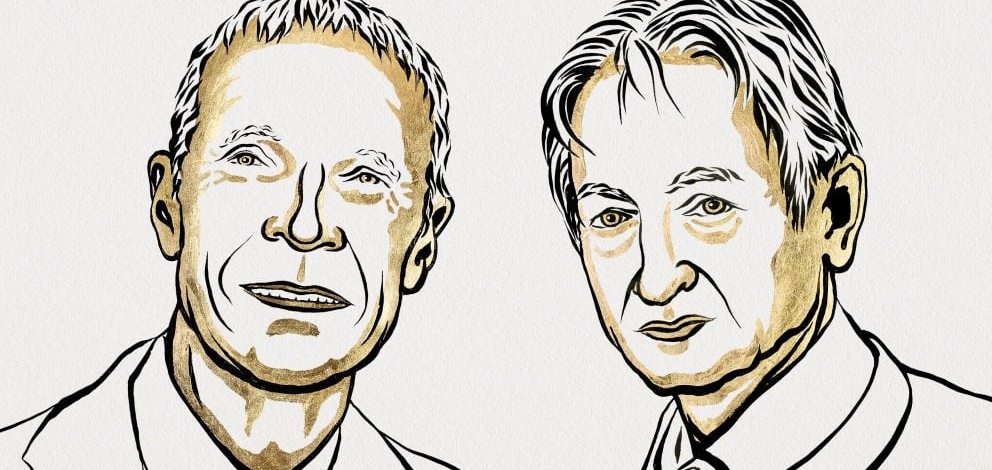

Glavna ideja Hopfieldove mreže temelji se na analogiji između neuronskih mreža u mozgu i kompleksnih sustava s kolektivnim ponašanjem. Jedan od ključnih koncepata iz statističke fizike koji se koristi u Hopfieldovom radu je Isingov model, koji je originalno razvijen za opisivanje magnetskih svojstava materijala. Isingov model opisuje sustav atoma koji mogu biti u jednom od dva stanja – “spin gore” ili “spin dolje” – koji su međusobno povezani interakcijama koje utječu na kolektivno ponašanje sustava. Ovisno o snazi tih interakcija, cijeli sustav može usvojiti globalno uređen ili neuređen raspored spinova, dakle može biti magnetiziran ili ne. Slično, umjetni neuroni mogu biti u jednom od dva stanja: aktivni (što bi odgovaralo “spinu gore”) ili neaktivni (što bi odgovaralo “spinu dolje”).

Hopfieldova mreža može pohraniti određene obrasce kao stabilna stanja minimalne energije. Kasa govorimo o svojstvima i treniranju neuronskih mreža često koristimo pojmove iz fizike – energija i temperatura, no ti pojmovi imaju drugačije značenje. Energija mjeri koliko dobro mreža uči određeni uzorak podataka – niža energija znači bolju prilagodbu, dok viša energija označava da mreža još nije optimalno naučila taj uzorak. Temperaturu ćemo objasniti kasnije. Hopfieldova mreža ima simetrične veze između neurona, što znači da težina veze od neurona A do neurona B uvijek ima istu vrijednost kao i veza od neurona B do neurona A. Ova simetričnost je važna jer omogućuje postojanje stabilnih stanja koja mreža može doseći. Hopfield je uveo i matematički formalizam za prilagođavanje težina veza u mreži kako bi se osiguralo da određeni uzorci predstavljaju stabilna stanja mreže. Ovaj proces “učenja” temelji se na prilagođavanju težina na način da mreža minimizira svoju energiju kada se određeni uzorci unesu. U osnovi, mreža “nauči” prepoznati određene obrasce tako što mijenja svoje unutarnju strukturu kako bi ih pravilno pohranila. Uvođenjem termodinamičkih principa u neuronske mreže Hopfield je prepoznao da se ponašanje neuronske mreže može modelirati pomoću istih principa koji upravljaju ponašanjem fizikalnih sustava na mikroskopskoj razini. Na primjer, mreža se može “hladiti” kroz proces minimizacije energije. Proces minimizacije energije u Hopfieldovim mrežama sličan je konceptu simuliranog kaljenja (eng. simulated annealing), koji se koristi u statističkoj fizici za pronalaženje globalnog minimuma energije u složenim sustavima.

Geoffrey Hinton, rođen 1947. godine, je britansko-kanadski računalni znanstvenik, kognitivni znanstvenik i psiholog. Poznat je i po nadimku “kum umjetne inteligencije” zbog ogromnog doprinosa polju. Trenutno je profesor emeritus na Sveučilištu u Torontu. 2023. godine napustio je Google, izražavajući zabrinutost zbog rizika koje donosi istraživanje umjetne inteligencije. U suradnji s Terryjem Sejnowskim, Hinton je 1985. godine objavio rad “Learning and Relearning in Boltzmann Machines” (MIT Press, 1986).

Boltzmannovi strojevi (eng. Boltzmann Machines ) su stohastičke neuronske mreže koje koriste probabilistički pristup učenju. Oni su proširenje Hopfieldovih mreža, s dodatkom stohastičkog elementa koji omogućuje neuronima da budu u aktivnom stanju s određenom vjerojatnošću, ovisno o ulazu koji primaju (za razliku od klasičnih neuronskih mreža gdje je aktivacija neurona deterministički proces). Ova mreža nazvana je po Ludwigu Boltzmannu, jednom od pionira statističke fizike, čiji su radovi o entropiji i termodinamici pružili temelj za razvoj ovakvih stohastičkih modela.

U fizici, Boltzmannova distribucija opisuje raspodjelu čestica po energetskim razinama u sustavu u ravnoteži pri određenoj temperaturi. Ovaj koncept je temelj Boltzmannovog stroja, gdje se energija sustava određuje stanjem svih neurona, i moramo minimizirati tu energiju kako bi pronašli optimalna rješenja za određeni problem. Boltzmannov stroj za to koristi proces koji smo spomenuli i kod Hopfieldove mreže – simulirano kaljenje, što omogućuje mreži da izbjegne lokalne minimume energije i pronađe globalni minimum – idealno rješenje. Kaljenje je metoda inspirirana procesom hlađenja materijala u metalurgiji, gdje se materijal prvo zagrijava do visoke temperature, a zatim se polako hladi kako bi se omogućilo stvaranje kristalne strukture bez defekata.

Da bi razumjeli proces simuliranog kaljenja prvo moramo objasniti što znači temperatura u Boltzmannovom stroju. Temperatura služi kao parametar koji utječe na vjerojatnost aktiviranja neurona. Na višim temperaturama, sustav je “nemirniji” i neuroni se aktiviraju s većom stohastičkom varijabilnošću, što omogućuje mreži da istražuje različite konfiguracije stanja. Kako se temperatura smanjuje, sustav postaje stabilniji, a neuroni teže ostati u stanjima koja minimiziraju energiju. U kontekstu Boltzmannovih strojeva, simulirano kaljenje omogućuje Boltzmannovim strojevima da pronađu globalne minimume energije, čime se poboljšava sposobnost mreže da uči složene obrasce iz podataka.

Boltzmannovi strojevi postali su ključni alati u razvoju generativnih modela – vrsta neuronskih mreža koje ne samo da mogu klasificirati podatke, već mogu i stvarati nove primjere naučenih obrazaca. Primjerice, generativni modeli omogućuju mrežama da “nauče” strukturu podataka, a zatim generiraju nove uzorke koji su slični onima iz skupa podataka na kojem su trenirane (za primjer razni generatori slika, Dali, Flux, Midjourney …). Ovi modeli su također postali temelj za kasniji razvoj dubokih neuronskih mreža, gdje se više slojeva Boltzmannovih strojeva koristi za učenje sve složenijih reprezentacija podataka. Ograničeni Boltzmannovi strojevi (eng. Restricted Boltzmann Machines – RBM), koji su pojednostavljena verzija Boltzmannovih strojeva, odigrali su ključnu ulogu u razvoju dubokog učenja.

Osim rada na Boltzmannovim strojevima, Hinton je značajno pridonio razvoju algoritmima za treniranje višeslojnih perceptrona. U radu “Learning representations by back-propagating errors” (Nature, 1986), koji je napisao zajedno s Davidom Rumelhartom i Ronaldom Williamsom, predstavljen je algoritam koji je omogućio učinkovito treniranje dubokih neuronskih mreža. Hintonov rad je također bio ključan u razvoju konvolucijskih neuronskih mreža i autoenkodera, koji su danas široko korišteni u područjima poput računalnog vida i obrade prirodnog jezika.

Umjetne neuronske mreže danas imaju važnu ulogu u fizici, gdje se koriste za analizu složenih sustava

Primjena fizikalnih koncepata na neuronske mreže ne samo da je obogatila područje umjetne inteligencije, već je otvorila nove mogućnosti za fizičare koji koriste te alate u svojim istraživanjima. Umjetne neuronske mreže danas imaju važnu ulogu u fizici, gdje se koriste za analizu složenih sustava, otkrivanje novih materijala te predviđanje ponašanja kvantnih sustava. Mogli bismo ovakve primjere nabrajati unedogled, ne samo za fiziku, nego za gotovo sve znanstvene discipline. Doprinosi Johna Hopfielda i Geoffreyja Hintona bili su revolucionarni, postavljajući temelje za eksponencijalni rast umjetne inteligencije i strojnog učenja. Njihova sposobnost da primijene koncepte iz fizike na neuronske mreže omogućila je razvoj tehnologija koje danas imaju nemjerljiv utjecaj na društvo. Njihov rad naglašava važnost interdisciplinarnog pristupa u znanosti, gdje se ideje iz jedne discipline mogu uspješno primijeniti u drugoj, vodeći do inovacija koje oblikuju našu budućnost.

Boltzmannov stroj i Isingov model samo su dvije ideje iz širokog repertoara statističke fizike. U svojoj knjizi „Critical Mass: How One Thing Leads to Another“, Philip Ball istražuje kako složeni kolektivni fenomeni u fizici, poput ponašanja čestica ili ljudskih društava, proizlaze iz jednostavnih interakcija. Svakako preporučujem ovu knjigu za dublje razumijevanje tih fascinantnih principa.

Komentari da je Nobelova nagrada iz fizike dodijeljena prvi put nekome tko nije fizičar (Hinton) ukazuju na krizu fizike nisu utemeljeni. Nobelova nagrada, kao što sam već rekao, slavi domete fizike i nagrađuje ljude koji su svojim radom obogatili civilizaciju novim spoznajama. Te spoznaje nisu samo fundamentalne, već će biti iskorištene za unapređenje kvalitete života. Naravno, možemo raspravljati i o potencijalno negativnim utjecajima tih tehnologija, ali ovo nije ni prvi ni posljednji alat s takvim potencijalom. Na nama je da naučimo kako ga ispravno koristiti. Za kraj, kao fizičar ću dodati – gledajući razvoj znanstvenih disciplina, možda je došlo vrijeme da uvedemo novu kategoriju: Nobelovu nagradu za računalne znanosti.